Einleitung

Cloud-basierte KI-Tools wie ChatGPT stellen Unternehmen vor DSGVO-Herausforderungen durch Datentransfers in Drittländer. GPT4All bietet eine praktische Alternative: Ein vollständig lokales Large Language Model, das ohne Internetverbindung auf deinem eigenen System läuft. In diesem Leitfaden zeigen wir dir, wie du GPT4All installierst, konfigurierst und effektiv nutzt für DSGVO-konforme KI-Anwendungen ohne Kompromisse bei der Funktionalität.

DSGVO und KI: Die Herausforderung

Wie bereits in unseren anderen Beiträgen erläutert (bspw. Post über open-source-llm-modelle), entstehen bei Cloud-KI-Diensten Datenschutzprobleme durch die Übertragung personenbezogener Daten an Drittanbieter. Lokale KI-Lösungen wie GPT4All eliminieren diese Risiken vollständig, da alle Daten auf deinen eigenen Systemen verbleiben.

GPT4All: Die Open-Source Alternative

Was ist GPT4All?

GPT4All ist ein kostenloses, Open-Source-Projekt, das es ermöglicht, leistungsstarke Sprachmodelle vollständig offline auf Desktop-Computern auszuführen. Das Projekt wurde von Nomic AI entwickelt und macht KI-Technologie für jeden zugänglich ohne Cloud-Abhängigkeiten oder Datenschutzbedenken.

Geschichte und Entwicklung

GPT4All entstand 2023 als Reaktion auf die Beschränkungen kommerzieller KI-Dienste. Das Projekt basiert auf der Idee, dass leistungsstarke KI-Modelle nicht ausschließlich in der Cloud laufen müssen. Durch intelligente Optimierungen und Quantisierung können moderne LLMs auch auf Standard-Hardware effizient betrieben werden.

Kernvorteile von GPT4All

Vollständige Datenkontrolle: Alle Eingaben und Ausgaben bleiben auf deinem System. Keine Datenübertragung an externe Server bedeutet automatische DSGVO-Compliance ohne zusätzliche Maßnahmen.

Keine laufenden Kosten: Nach der einmaligen Installation entstehen keine Abonnementgebühren oder API-Kosten. Besonders vorteilhaft für Unternehmen mit hohem KI-Nutzungsvolumen.

Offline-Funktionalität: GPT4All arbeitet vollständig ohne Internetverbindung. Ideal für sensible Umgebungen oder bei instabiler Internetanbindung.

Modellvielfalt: Unterstützung verschiedener Sprachmodelle, von kompakten 3B-Parameter-Modellen bis hin zu leistungsstarken 13B-Parameter-Varianten.

Unterstützte Modelle und Fähigkeiten

GPT4All unterstützt eine breite Palette optimierter Modelle:

- Llama 3 Varianten: Von Meta entwickelte Modelle mit verschiedenen Parametergrößen

- Mistral-Modelle: Besonders effiziente europäische KI-Modelle

- Mehrsprachige Modelle: Mit verbesserter deutscher Sprachunterstützung

Die Modelle beherrschen typische KI-Aufgaben wie Textgenerierung, Zusammenfassungen, Übersetzungen, Code-Generierung und Frage-Antwort-Systeme.

Systemanforderungen

Minimale Anforderungen:

- 8 GB RAM für kleinere Modelle (3B Parameter)

- 4 GB freier Festplattenspeicher

- x64-prozessor (Intel/AMD)

Empfohlene Konfiguration:

- 16 GB RAM oder mehr für bessere Performance

- SSD-Festplatte für schnellere Modell-Ladezeiten

- Moderne CPU mit mehreren Kernen

GPU-Beschleunigung (optional):

- NVIDIA RTX-Grafikkarten mit 8+ GB VRAM

- Deutlich verbesserte Antwortzeiten bei größeren Modellen

Installation von GPT4All

Download und Grundinstallation

Die Installation von GPT4All ist denkbar einfach und in wenigen Minuten abgeschlossen:

Windows:

- Besuche die offizielle Website www.nomic.io/gpt4all

- Lade die Windows-Version herunter (ca. 2 GB)

- Führe die .exe-Datei als Administrator aus

- Folge dem Installationsassistenten

- GPT4All wird automatisch im Startmenü verfügbar

macOS:

- Lade die .dmg-Datei für macOS herunter

- Öffne die Datei und folge dem Installationsassistenten

- Bei der ersten Ausführung bestätige die Sicherheitsabfrage

- GPT4All ist sofort einsatzbereit

Linux:

- Lade die run Datei herunter

- Mache die Datei ausführbar

- Führe die run Datei aus

Erste Einrichtung und Konfiguration

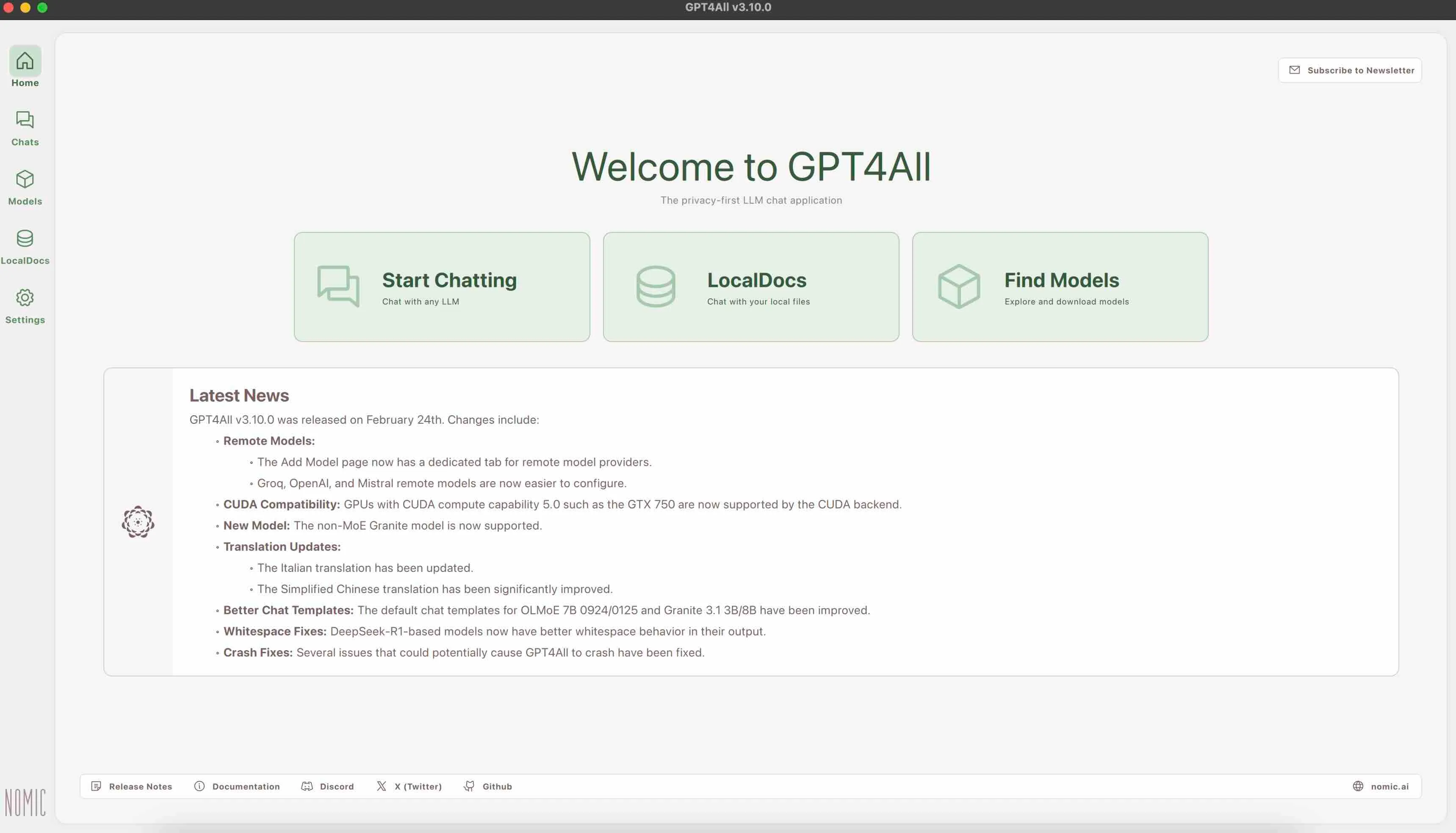

Nach der Installation startet GPT4All mit einem Willkommensbildschirm:

Spracheinstellung: Wähle Deutsch als Benutzersprache für eine lokalisierte Oberfläche.

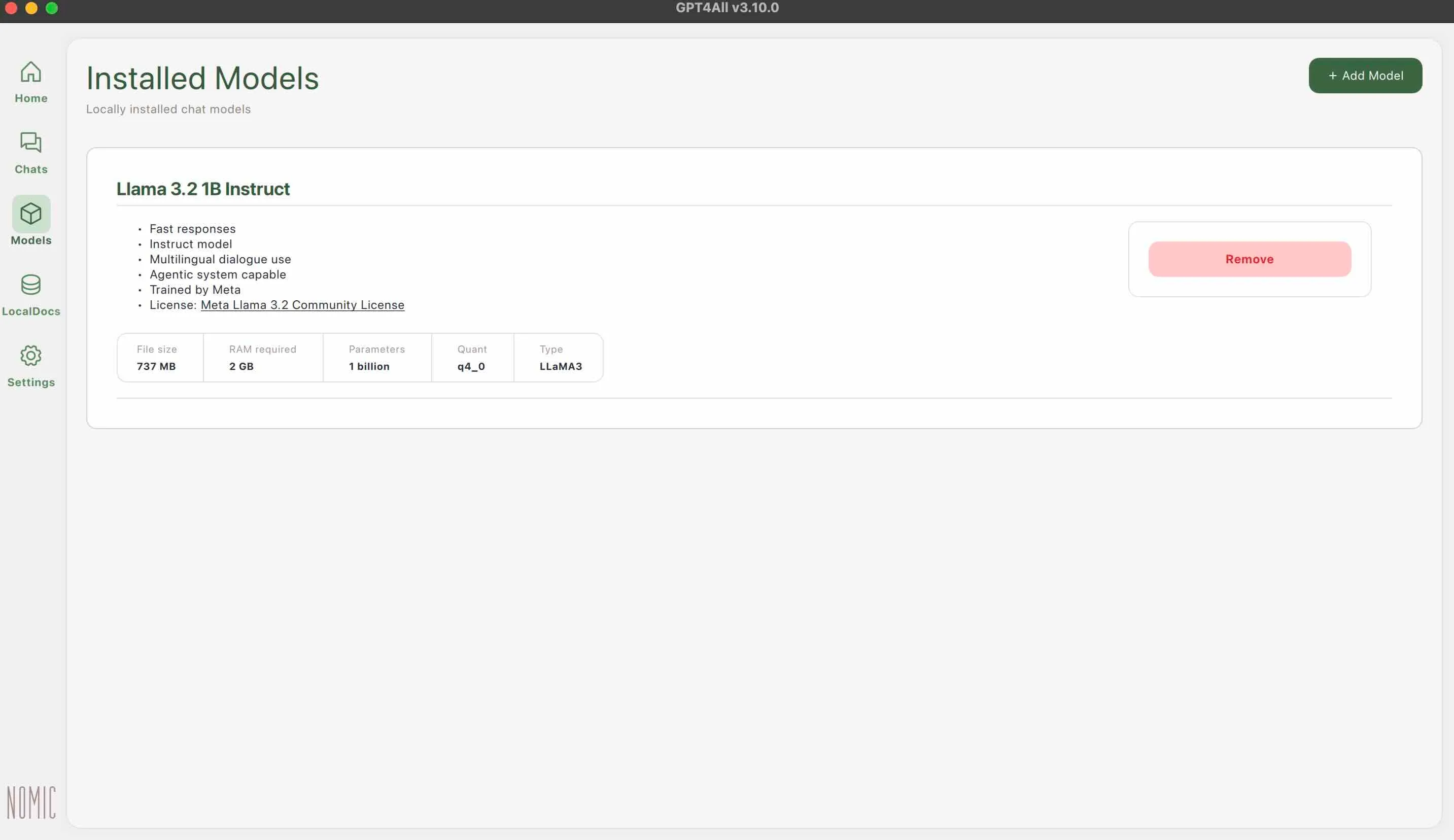

Modellauswahl: GPT4All zeigt eine Liste verfügbarer Modelle. Für den Einstieg empfehlen wir:

- “Llama 3 8B Instruct” für ausgewogene Performance

- “Llama 3.2 1B Instruct” zum Test mit wenig Resourcenbedarf

- “Mistral Instruct (7B)” für deutsche Texte

Downloadmanagement: Durch Klick auf den jeweligen Download Button werden Modelle heruntergeladen und lokal gespeichert. Ein 7B-Modell benötigt etwa 4 bis 6 GB Speicherplatz.

Erweiterte Konfiguration

Leistungsoptimierung:

- CPU-Threads: Standardmäßig nutzt GPT4All alle verfügbaren CPU-Kerne

- GPU-Beschleunigung: Aktiviere CUDA-Support für NVIDIA-Grafikkarten

- Speicherverwaltung: Begrenze den RAM-Verbrauch bei Bedarf

Datenschutzeinstellungen:

- Deaktiviere Telemetrie-Daten vollständig

- Lokaler Chatverlauf: Alle Gespräche werden nur lokal gespeichert

- Modell-Updates: Entscheide selbst über Aktualisierungen

GPT4All in der Praxis nutzen

Die Benutzeroberfläche verstehen

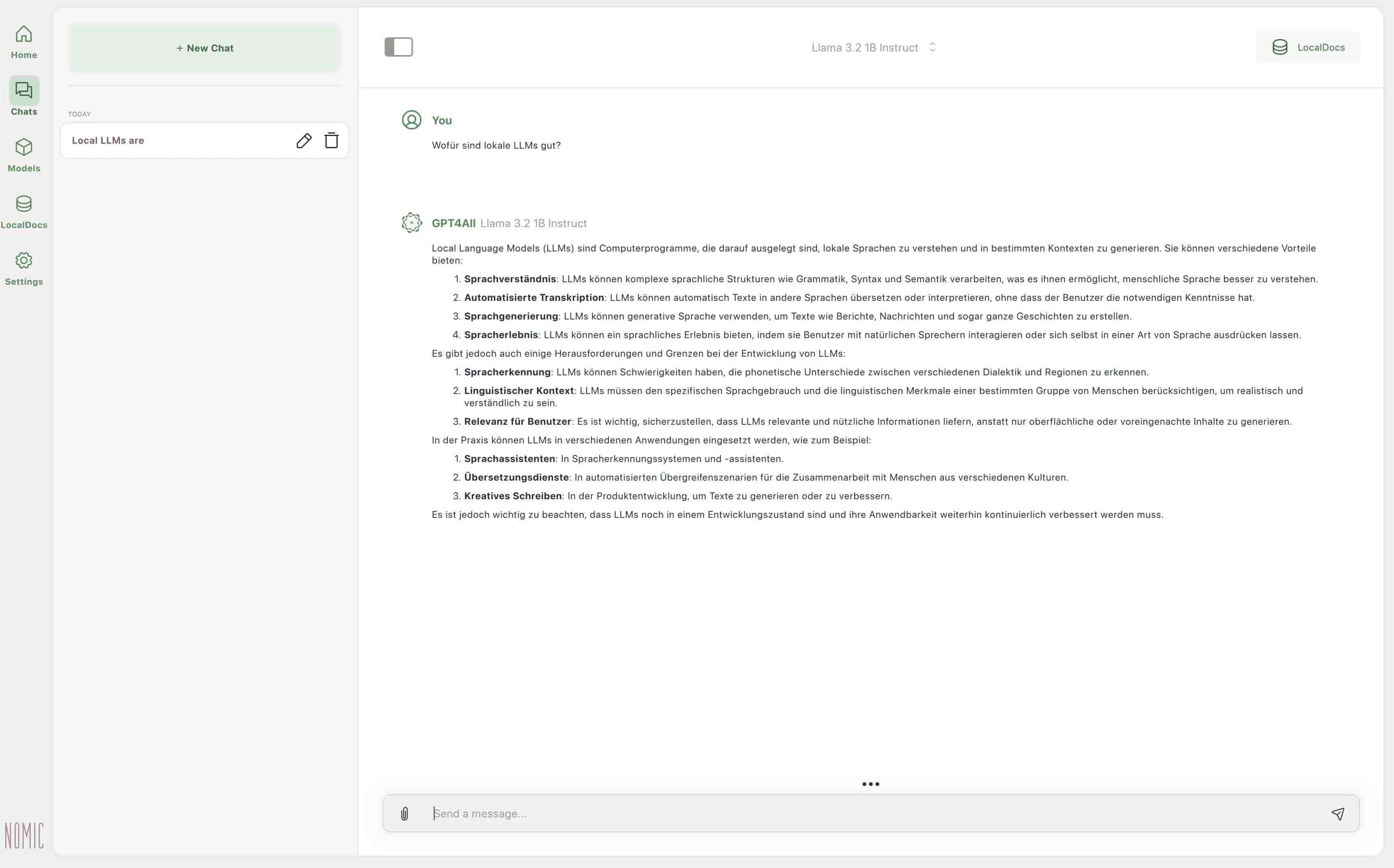

GPT4All präsentiert sich mit einer intuitiven, Chat-ähnlichen Oberfläche:

Hauptfenster/Chats: Der zentrale Bereich zeigt das Gespräch zwischen dir und dem KI-Modell.

Modellliste: Links findest du alle installierten Modelle. Ein einfacher Klick oben im Chatfenster wechselt zwischen verschiedenen KI-Modellen, ohne das Gespräch zu beenden.

Local Docs: Unter Local Docs kannst du GPT4ALL eigene Dateien als Knowledgebase zur Verfügung stellen. Die Dateien bleiben natürlich lokal, werden aber intern in eine lokale Vector Datenbank eingelesen.

Systemeinstellungen: Über das Zahnrad-Symbol erreichst du erweiterte Optionen wie LLM-Temperatur-Einstellungen, maximale Antwortlänge und Leistungsparameter.

Erste Gespräche führen

Einfache Fragen: Beginne mit direkten Fragen wie “Erkläre mir Quantencomputing in einfachen Worten” oder “Schreibe eine E-Mail-Vorlage für Kundenbeschwerden”.

Speicherung des Kontexts: GPT4All merkt sich den Gesprächsverlauf. Du kannst nachfragen, präzisieren oder das Thema vertiefen, ohne alles zu wiederholen.

Deutsche Prompts: Die Modelle verstehen deutsche Eingaben gut. Formuliere deine Anfragen klar und spezifisch für beste Ergebnisse.

Modelle vergleichen und wechseln

Verschiedene Modelle haben unterschiedliche Stärken:

Llama 3 Modelle: Ausgewogene Allround-Performance, gut für Geschäftstexte und allgemeine Fragen.

Mistral-Modelle: Oft präziser bei deutschen Texten, effizienter bei begrenzten Ressourcen.

Größere vs. kleinere Modelle: 13/8B-Parameter-Modelle liefern meist bessere Ergebnisse, benötigen aber mehr RAM und Zeit.

Tipps für bessere Ergebnisse

Spezifische Prompts: Statt “Schreibe Text” verwende “Schreibe eine professionelle E-Mail an Kunden über Lieferverzögerungen mit Entschuldigung und Lösungsvorschlag”.

Schritt-für-Schritt-Anweisungen: Bei komplexen Aufgaben helfen strukturierte Prompts: “1. Analysiere das Problem, 2. Entwickle drei Lösungsansätze, 3. Bewerte jeden Ansatz”.

Beispiele verwenden: Gib Beispiele für gewünschte Ausgaben: “Schreibe im Stil dieses Beispiels: [Beispieltext]”.

Iterative Verbesserung: Verfeinere Antworten durch Nachfragen: “Mache den Text formeller” oder “Kürze auf 100 Wörter”.

Erweiterte Funktionen und Integration

API-Nutzung für Entwickler

GPT4All bietet eine REST-API für programmatische Nutzung:

Lokaler API-Server: Starte GPT4All im Server-Modus für HTTP-Anfragen an localhost:4891. Perfekt für eigene Anwendungen ohne externe Abhängigkeiten.

Python-Integration: Nutze die offizielle Python-Bibliothek für nahtlose Integration in bestehende Skripte und Automatisierungen.

Batch-Verarbeitung: Verarbeite große Textmengen automatisiert ideal für Dokumentenanalyse oder Content-Generierung.

Integration in Workflows

Dokumentenverarbeitung: Nutze GPT4All für automatische Zusammenfassungen, Übersetzungen oder Textanalysen großer Dokumentenbestände.

Content-Erstellung: Generiere Blogpost-Entwürfe, Social-Media-Inhalte oder Produktbeschreibungen vollständig offline.

Code-Assistenz: Lass Code erklären, dokumentieren oder Fehler finden ohne sensiblen Code an externe Services zu senden.

Performance-Optimierung

Hardware-Tuning: Nutze alle CPU-Kerne, aktiviere GPU-Beschleunigung und stelle ausreichend RAM zur Verfügung.

Modell-Management: Behalte nur benötigte Modelle installiert und nutze quantisierte Versionen für bessere Performance.

Caching: GPT4All cacht häufig verwendete Berechnungen für schnellere Wiederholungen ähnlicher Anfragen.

Entdecke den decentnodes Newsletter

Als Newsletter Abonnent beibst du immer auf dem laufenden in Bezug auf neue KI und DevOps-Tools, Security Breaches etc. Außerdem bekommst du Insides zu den wichtigsten decentnodes Aha-Momenten und du erhältst ca. einmal im Monat einen Link zu unserer kostenfreien monatlichen AMA Session, wo du alle Fragen rund um die Themen KI und DevOps stellen kannst.

Hinweis: Wenn das Formular nicht funktioniert, navigiere am Ende der Website auf Cookie Einstellungen, erlaube den Cookie Brevo und lade die Seite neu.

FAQ: Häufige Fragen zu GPT4All

Ist GPT4All wirklich kostenlos? Ja, GPT4All ist vollständig kostenlos und Open Source. Es entstehen keine versteckten Kosten, Abonnementgebühren oder API-Limits.

Wie gut ist die Qualität im Vergleich zu ChatGPT? Die Qualität liegt meist etwas unter ChatGPT-4, ist aber für viele Anwendungen völlig ausreichend. Besonders bei deutschen Texten und fachspezifischen Themen können lokale Modelle durch Anpassung sogar überlegen sein.

Welche Hardware wird mindestens benötigt? 8 GB RAM für kleinere Modelle, 16 GB für komfortable Nutzung. Die meisten modernen Laptops und Desktop-PCs sind ausreichend.

Gibt es Beschränkungen bei der Nutzung? Nein, es gibt keine Anfragelimits, Zeitbeschränkungen oder Nutzungseinschränkungen. Du kannst GPT4All 24/7 verwenden.

Funktioniert GPT4All offline? Ja, nach der Installation und dem Modell-Download läuft GPT4All vollständig offline ohne Internetverbindung.

Kann ich eigene Modelle trainieren? GPT4All selbst trainiert keine Modelle, aber du kannst vortrainierte Modelle mit eigenen Daten fine-tunen oder spezialisierte Varianten verwenden.

Fazit und Ausblick

GPT4All revolutioniert den Zugang zu KI-Technologie durch vollständige lokale Kontrolle bei gleichzeitig beeindruckender Leistungsfähigkeit. Für Unternehmen, die DSGVO-Compliance ernst nehmen, stellt es eine praktikable Alternative zu Cloud-basierten KI-Services dar.

Die Lösung eignet sich besonders für Organisationen mit sensiblen Daten, begrenzten Budgets oder dem Wunsch nach technologischer Unabhängigkeit. Mit kontinuierlichen Verbesserungen der zugrunde liegenden Modelle wird die Qualität lokaler KI-Lösungen weiter steigen.

GPT4All ist ideal für:

- Datenschutzsensible Unternehmen und Behörden

- Entwickler und IT-Teams

- Content-Ersteller mit hohem Durchsatz

- Bildungseinrichtungen

- Alle, die KI ohne Vendor-Lock-in nutzen möchten

Die Zukunft gehört hybriden Ansätzen: Cloud-KI für maximale Leistung, lokale KI für Datenschutz und Kontrolle. GPT4All macht diesen Übergang heute schon möglich.